|

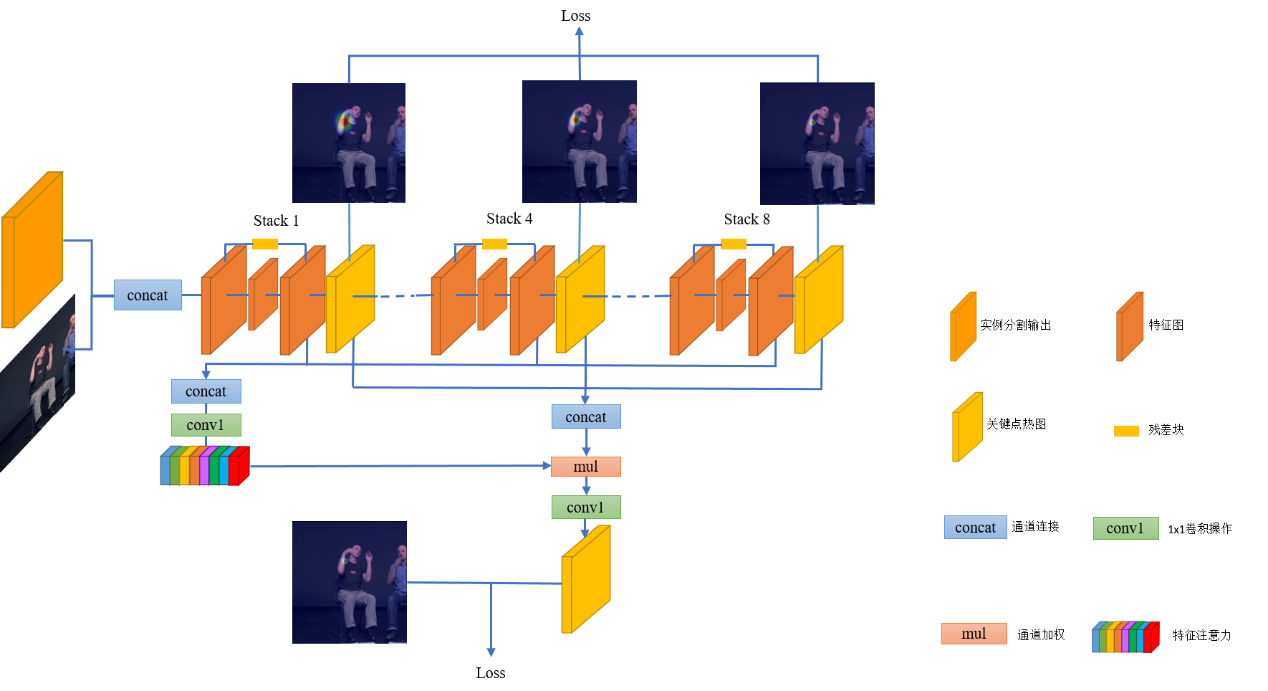

视频行为分析是一个前沿且具有挑战的任务,因为其不仅仅要分析目标体的空间信息,还要分析时间维度上的信息,如何更好的提取出空间-时间特征是问题的关键。在近年的国际计算机视觉顶级会议与期刊(如CVPR、ICCV、ECCV等会议,TPAMI、IJCV等期刊)上均有与视频行为分析相关的大量文章,尽管有一些研究工作已经极大推动了该方向的进步,但仍有一些问题亟待解决。例如如何有效提取时序信息、如何将空间与时序信息高效融合等。 计算机科学与工程学院张宇教授团队针对当前视频行为理解领域使用的视频采样方法不能充分提取视频信息的问题,研究新型的视频采样方法,达到采样丰富视频信息的目的,以使得神经网络学习到提取有效信息的结构特征。具体方法包括:全局与局部结合的视频采样方法、自适应帧的视频采样方法。而针对当前深度时空卷积神经网络对视频序列时间维度动态信息利用不充分的问题,本研究通过消除深度卷积神经网络对视频中空域表观信息的过度依赖,达到使网络更加关注时域动态转换信息的目标。具体方法包括:时域特征提取优化方法、模型参数的时域自适应正则化方法。 另外针对姿态估计问题,由于复杂场景中存在太多的背景干扰信息,本研究团队采用的人体姿态估计方法基于自顶向下(top-down)的人体姿态估计方法,通过检测获得人体边界框(bounding box),将人体边界框区域的子图作为模型的输入,排除大部分来自背景的干扰信息。人体边界框定位的准确性大大影响人体姿态估计的准确性,而获得实例分割的输出能更精确定位人体的位置,为姿态估计模型提供更多有效的信息,因而本项目将实例分割的输出和检测获得的人体边界连接,作为模型的输入。基于多尺度的姿态估计策略提供了多尺度的人体姿态估计特征,如何融合多尺度的姿态估计特征是姿态估计算法设计的重点。注意力模型最近几年在深度学习各个领域被广泛应用,其通过来自图像上下文信息,从大量的图像特征中的选取高价值特征,实现图像特征的有效融合。因而,本项目将采用基于注意力机制的多级特征融合的姿态估计方法,如何获取和应用特征注意力是该方法的核心。多尺度人体姿态特征中包含了来自人体关键点附近的多尺度空间上下文信息,同时也包含了不同关键点坐标的之间的结构上下文信息。多尺度的空间上下文信息和结构上下文信息相结合,能够实现对重叠、遮挡的关键点坐标的有效推导。因而,如图2的下半部分,本项目将采用多尺度特征去生成多级热图特征的通道注意力,并对多级热图特征进行通道加权,最后通过1x1卷积操作,进而实现多级热图特征的有效融合,从而提升姿态估计的准确率。

复杂场景中的姿态估计算法框架

|